Douglas' Space

인공신경망의 기본, MLP 본문

Perceptron은 1957년 Frank Rosenblatt가 고안한 간단한 네트워크로 하나의 인공뉴런에 해당하는 단순한 분류기입니다. 이를 소개한 뉴욕타임즈의 기사는 조만간 인간과 같은 기계가 탄생할 것이라고 예견하기도 했습니다. 그러나 하나의 Perceptron으로 제한이 많아 다양한 문제를 풀기위해서는 Multi layer perceptron(MLP)으로 확장이 필요하다고 Marvin Minsky교수가 주장했지만 MLP를 이용하여 학습은 불가능하다고 주장하여 오랜기간 암흑기에 있었습니다.

MLP는 다음과 같이 여러층에 다수의 뉴런이 네트워크로 구성된 뉴럴넷입니다. 이 구조는 모든 뉴럴넷 구조의 가장 기본이 되는 구조입니다.

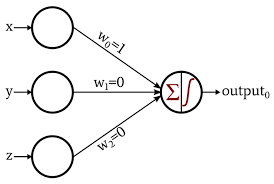

입력데이타 Xi와 연결되는 뉴런으로 구성된 계층을 입력층(input layer)이라 하고, 최종 출력데이타 Yi를 생성하는 계층을 출력층(output layer)이라 하며, 이 둘 사이에 존재하는 하나 이상의 계층을 은닉층(hidden layer)이라고 합니다. 원들은 출력의 방향으로 링크가 연결되어 있습니다. 각 링크는 가중치 Wi를 갖고 있습니다. 하나의 링크는 축삭돌기와 수상돌기, 그리고 이들의 접점인 시냅스로 간주할 수 있습니다. 따라서 하나의 뉴런은 입력되는 링크와 원(세포체를 의미), 그리고 출력되는 링크로 구성된다고 볼 수 있습니다.

하나의 뉴런은 다음과 같은 구조를 갖고 있습니다. 입력에 대해 가중치의 합을 구하고 활성화함수(activation function)를 통해 최종 출력의 값을 결정하게 됩니다.

'Computing Tech. Diary > Artificial Intelligence' 카테고리의 다른 글

| AI로 무엇을 할 수 있나?! (0) | 2022.04.28 |

|---|---|

| 인공지능이 강하고 약한 것이 있다고 하는데 ... (0) | 2022.04.28 |

| 인공신경망은 어떻게 학습할까? (0) | 2022.04.28 |

| 시스템으로서의 인공신경망 (0) | 2022.04.28 |

| 기억이란? (0) | 2022.04.28 |